傅聪谈DeepSeek_美国南加大学者在研究DeepSeek 24小时后,搞懂了模型降本的秘密

最近傅聪谈DeepSeek_美国南加大学者在研究DeepSeek 24小时后,搞懂了模型降本的秘密事件在热度非常高,为大家准备了完整关于傅聪谈DeepSeek_美国南加大学者在研究DeepSeek 24小时后,搞懂了模型降本的秘密事件的所有相关内容,如果大家想知道更多这方面的情况,请持续关注本站!

美国南加大学者在研究DeepSeek 24小时后,搞懂了模型降本的秘密

### DeepSeek 出圈背后:技术原理与创新解析

来源:新浪科技

文 | 新浪科技 周文猛

2025年蛇年春节前夕,DeepSeek 成为了全球瞩目的焦点。1月27日,DeepSeek 应用登顶苹果美国地区应用商店免费App下载排行榜,在美区下载榜上超越了 ChatGPT。同日,该应用也在中国区苹果应用商店免费榜上位列第一。

那么,DeepSeek 到底有何过人之处?近日,浙江大学计算机博士、美国南加州大学访问学者、《业务驱动的推荐系统:方法与实践》作者傅聪在与新浪科技的沟通中,深入解析了 DeepSeek 成功出圈背后的技术原理。

#### 技术突破与成本优化

目前,业界对 DeepSeek 的喜爱主要集中在三个方面:

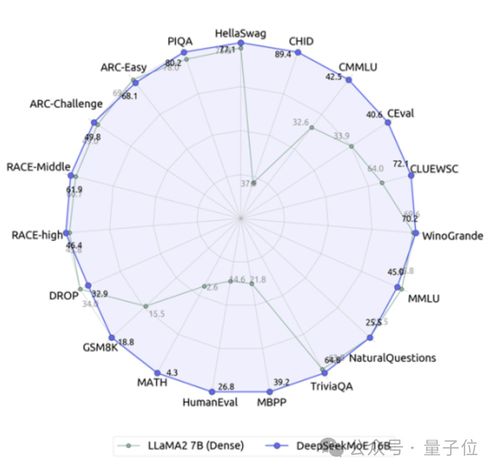

1. **模型能力**:DeepSeek-V3 和公司新近推出的 DeepSeek-R1 两款模型分别实现了比肩 OpenAI GPT-4o 和 o1 模型的能力。

2. **低成本优势**:这两款模型的成本仅为 OpenAI GPT-4o 和 o1 模型的十分之一左右。

3. **开源贡献**:DeepSeek 将这两大模型的技术开源,让更多 AI 团队能够基于最先进且成本最低的模型开发更多 AI 原生应用。

傅聪表示,DeepSeek 通过一系列技术创新实现了模型成本的大幅降低,同时保证了模型效果不逊色于 OpenAI 的顶级模型。具体来说,DeepSeek 主要采用了以下几种技术手段:

##### 1. 专家加载均衡技术

DeepSeek 使用了一种先进的、不需要辅助损失函数的专家加载均衡技术,确保每个 token 下仅有少量专家网络参数被激活,不同的专家网络能够以更均衡的频率被激活,防止专家网络激活扎堆。这项技术在 DeepSeek V2(2360亿参数规模)和 DeepSeek V3(6710亿参数规模)模型上都得到了验证,显示出显著的效果。

##### 2. 对偶流水线机制

DeepSeek 设计了一种“对偶流水线(Dual Pipeline)机制”,通过极致的流水线调度,将 GPU 中用于模型训练中数学运算的算力和通信相关的算力在流水线执行过程中进行“并行隐藏”。理论上,这一机制可以将 GPU 的指令执行流水线中的“气泡”减少接近一半,仅略微增加显存消耗。

##### 3. 稀疏激活设计

DeepSeek 充分利用专家网络被稀疏激活的设计,限制了每个 token 被发送往 GPU 集群节点的数量,从而使得 GPU 之间的通信开销保持在较低水平。

##### 4. FP8 混合精度训练

DeepSeek 实现并应用了 FP8 混合精度训练架构,在不同计算环节灵活使用 FP8、BF16 和 FP32 不同精度的数字表示,并在参数通信的部分过程也应用了 FP8 传输。这种方法不仅加快了计算速度,还降低了通信开销。

#### 提升模型效果的技术

除了降低成本外,DeepSeek 还通过多种技术提升了模型的效果。傅聪指出,除了沿用 Multi-Head latent Attention(MLA)架构外,DeepSeek 还应用了多 token 预测技术(multi token prediction),使得模型在训练时能同时预测序列后面更远的不同位置的 token,增强了模型的感知能力和效果。

此外,真正帮助 DeepSeek 追赶 OpenAI o1 的是最新模型 DeepSeek-R1。该模型几乎单纯使用强化学习技术进行“后训练”,让模型的推理能力得到了极大的提升。简单来说,就是让 R1 模型在“后训练”过程中,通过学习 CoT(思维链)的方式,一步一步推理得出结果,而不是直接预测答案。“这一方案,也是圈子内大家对 OpenAI o1 模型实现路径的猜测,而 DeepSeek 用极快的速度验证了这一路径的可行性!”傅聪表示。

#### 小模型的潜力与合成数据的重要性

傅聪认为,DeepSeek R1 所带来的技术突破不仅证明了强化学习(RL)以及 inference TIMe scaling law 的可行性,还证明了即便是小模型(7~13B),也可以通过 CoT RL 实现思考和自我演化,大幅提升推理能力。之前小模型往往因为幻觉严重而备受诟病,现在看来很多小模型在充分优化后也具备在应用场景落地的潜力。

此外,R1 的出现还会让学界和产业界更加重视合成数据,“后训练”时代对基于 CoT 思想的优质合成推理数据的需求将会大大增加。

总之,DeepSeek 的成功不仅在于其技术上的突破,更在于它为整个 AI 社区提供了新的思路和方向。

以上内容就是小编为大家整理的傅聪谈DeepSeek_美国南加大学者在研究DeepSeek 24小时后,搞懂了模型降本的秘密全部信息,如果大家还想了解更多后续或相关内容,请关注多特软件站,持续更新给大家带来最新消息!

了解更多消息请关注收藏我们的网站。